চেনা কণ্ঠ, অচেনা মানুষ: ভয়েস ফেক প্রযুক্তির উত্থান

কীভাবে AI-চালিত ভুয়া কণ্ঠস্বর প্রযুক্তি আপনার আর্থিক নিরাপত্তাকে ঝুঁকিতে ফেলছে এবং কেন রাষ্ট্র ও কর্পোরেশনের হস্তক্ষেপ এখন অপরিহার্য।

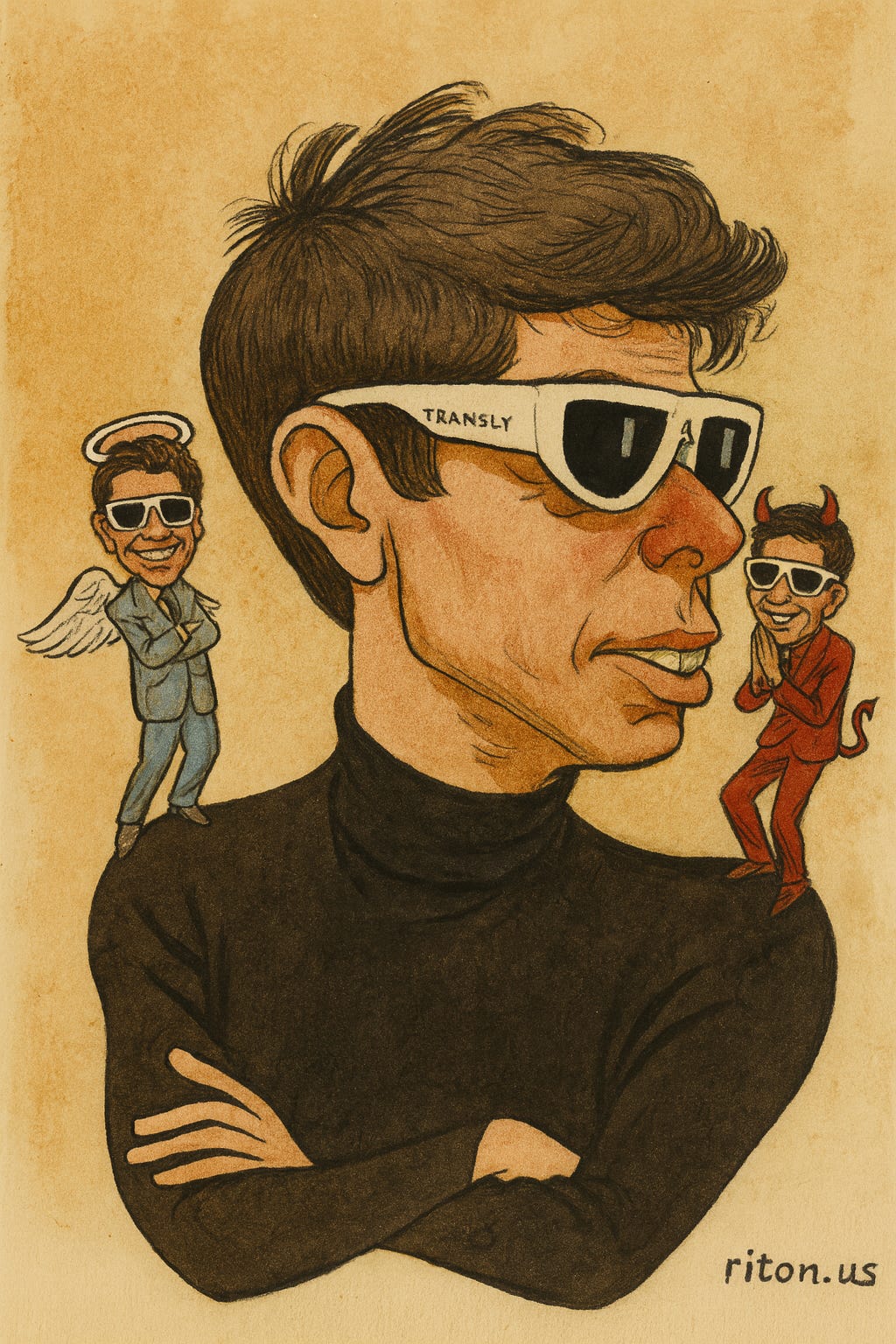

রিটন খান

সাম অল্টম্যান, যিনি OpenAI-র প্রধান নির্বাহী এবং ChatGPT-এর স্রষ্টাদের মধ্যে অন্যতম, সম্প্রতি এক গুরুত্বপূর্ণ উদ্বেগ প্রকাশ করেছেন—AI-নির্মিত কণ্ঠস্বর এখন এমন এক পর্যায়ে পৌঁছেছে যেখানে অপরাধীরা এই প্রযুক্তির অপব্যবহার করে আপনার পরিচয় নকল করে টাকা চুরি করতে পারছে। তার এই সতর্কতা নিঃসন্দেহে সময়োচিত এবং বাস্তবতা নির্ভর। বিশেষ করে ব্যাংকিং বা কাস্টমার সার্ভিসে, যেখানে কণ্ঠস্বরের মাধ্যমেই পরিচয় যাচাই করা হয়, সেখানে AI-generated voice দিয়ে প্রতারণার পথ খুলে যাচ্ছে।

অল্টম্যান যখন এই বিপদের কথা বলছেন, তখন সেটা কেবল প্রযুক্তির ভবিষ্যত নিয়ে কথা বলা নয়—তার নিজের প্রতিষ্ঠানের উদ্ভাবনগুলোর সামাজিক প্রভাব সম্পর্কে স্বীকারোক্তিও বটে। কিন্তু এখানে একটি বড় ভুলচুক রয়ে গেল। অল্টম্যান এই বিপদের কথা বললেও, তিনি তার নিজের প্রতিষ্ঠান এবং সমগ্র AI ইন্ডাস্ট্রির উপর যে নৈতিক দায় বর্তায়, সেটা স্পষ্ট করে তোলেননি। এই প্রতারণা কিন্তু কেবল অপরাধীদের দায় নয়—এর পেছনে AI কোম্পানিগুলোর প্রযুক্তিগত অবদানও রয়েছে, এবং সেই প্রযুক্তিকে নিয়ন্ত্রণ ও নিরাপদ করার দায়িত্ব তাদেরই।

সাম অল্টম্যান কেবল একজন প্রযুক্তি নির্বাহী নন—তিনি বর্তমানে AI জগতের নীতিনির্ধারকদের শীর্ষ সারিতে রয়েছেন। AI কীভাবে ব্যবহার হবে, আমরা কীভাবে তাকে বুঝবো, এবং তার সীমাবদ্ধতা ও ক্ষমতা সম্পর্কে আমাদের ধারণা গঠনে তার কথার ওজন অসাধারণ। এমন প্রভাবশালী নেতৃত্বের কাছ থেকে যখন আমরা কোনো বিষয়ে স্পষ্ট বার্তা পাই না, তখন সেই নীরবতাও একধরনের নৈতিক অবস্থান হয়ে দাঁড়ায়।

আপনার কণ্ঠস্বর যখন কেবলমাত্র কিছু সেকেন্ডের অডিও থেকেই অনায়াসে নকল করা যায়, তখন ব্যক্তিগত সচেতনতা আর সাবধানতা যথেষ্ট নয়। এই পরিস্থিতি নাগরিককে এক অসম প্রতিযোগিতায় ফেলে দেয়—যেখানে অপরাধীরা অত্যাধুনিক AI টুলস ব্যবহার করে, আর সাধারণ মানুষ তাদের রক্ষা করতে পারে না। ফলে, এই লড়াইয়ে ব্যক্তির একার পক্ষে জয়ী হওয়া অসম্ভব।

এই কারণেই কর্পোরেশন ও রাষ্ট্রের হস্তক্ষেপ এখন অনিবার্য। শুধুমাত্র সরকারের নীতিগত নিয়ন্ত্রণ এবং কর্পোরেট দায়িত্ববোধের মাধ্যমে এই প্রযুক্তিগত হুমকি সামাল দেওয়া সম্ভব। AI-নির্মিত ভুয়া কণ্ঠস্বর, পরিচয় প্রতারণা, এবং ব্যাংকিং সিকিউরিটি লঙ্ঘনের মতো সমস্যাগুলো প্রতিরোধ করতে হলে কর্পোরেশনগুলিকে তাদের পণ্যে নিরাপত্তা বিল্ট-ইন করতে হবে এবং সরকারকে সেই নিরাপত্তার মানদণ্ড নির্ধারণ করতে হবে।

এখানেই আসল প্রশ্ন—প্রযুক্তি কি মানবকল্যাণে নিয়োজিত হতে পারবে, নাকি তা অপরাধীদের হাতেই শক্তিশালী হাতিয়ার হয়ে উঠবে? কৃত্রিম বুদ্ধিমত্তার এই প্রথম সত্যিকারের পরীক্ষা হলো: রাষ্ট্র ও কর্পোরেশন মিলে প্রযুক্তির ঝুঁকি কীভাবে মোকাবিলা করে, এবং জনগণের স্বার্থকে কতটা অগ্রাধিকার দেয়। যদি তারা ব্যর্থ হয়, তবে এই প্রযুক্তি আমাদের জীবনকে উন্নত করার পরিবর্তে অনিরাপদ করে তুলবে।

AI দিয়ে বানানো ভুয়া কণ্ঠস্বর কোনও নতুন আবিষ্কার নয়। মার্কিন পররাষ্ট্র সচিব মার্কো রুবিওর নামে তৈরি ভুয়া অডিও কিংবা এক দম্পতির কাছে নকল কণ্ঠে নাতির জরুরি জামিনের জন্য টাকা চাওয়ার প্রতারণা—এসব ঘটনার নজির রয়েছে। কিন্তু গত এক বছরে এই প্রযুক্তির স্তরগত পরিবর্তন ঘটেছে এক অভূতপূর্ব গতিতে।

AI গবেষক হেনরি অ্যাজডারের ভাষায়, এখন অনলাইনে বিনামূল্যে সহজলভ্য যে সফটওয়্যারগুলো পাওয়া যাচ্ছে, সেগুলোর সাহায্যে যেকোনো ব্যক্তি মাত্র কয়েক সেকেন্ডের অডিও রেকর্ডিং থেকে অবলীলায় তৈরি করতে পারে এক নিখুঁত নকল কণ্ঠস্বর—একটি ‘ভয়েস ডোপেলগ্যাঞ্জার’। অর্থাৎ, আপনি কিছু বলতে না বলতেই, আপনারই কণ্ঠে AI-চালিত কোন অপরিচিত ব্যক্তি কথা বলতে শুরু করতে পারে।

এই ভয়াল বাস্তবতা আরও গভীর হয় যখন জানা যায়—এই প্রযুক্তিগুলোর প্রায় কোনও গার্ডরেল নেই। না আছে কোনও বাধা সাধারণ মানুষের কণ্ঠ নকল করতে, না আছে বিখ্যাত ব্যক্তিদের কণ্ঠস্বর ব্যবহারের বিরুদ্ধে কোনও সুরক্ষা। AI-এর এই 'open frontier' আজ মূলত এক উন্মুক্ত প্রতারণার মঞ্চ।

এখনকার AI voice cloning প্রযুক্তি খুব সহজলভ্য, অল্প সময়ে করা যায়, এবং অধিকাংশ ক্ষেত্রেই কোনও আর্থিক খরচ ছাড়াই। এ এক নতুন মাত্রার ‘deepfake’ বিপদ, যার বিরুদ্ধে ব্যক্তি বা পরিবার একা দাঁড়াতে পারবে না—প্রতিরোধ গড়ে তুলতে হলে লাগবে বৃহৎ সামাজিক-প্রাতিষ্ঠানিক প্রস্তুতি, প্রযুক্তি নির্মাতাদের নৈতিক দায়বোধ, এবং আইনি রক্ষাকবচ।

হেনরি অ্যাজডার একটি নির্মম কিন্তু বাস্তব সত্য উচ্চারণ করেন: “আপনি নিজেকে লক্ষ্যবস্তু হওয়া থেকে মূলত রক্ষা করতে পারবেন না।” অর্থাৎ, যতই সাবধান হোন না কেন, কণ্ঠস্বর নকলের হাত থেকে মুক্তি পাওয়া প্রায় অসম্ভব।

এই সতর্কতার প্রেক্ষিতে সাম অল্টম্যান এবার সরাসরি আঙুল তুলেছেন আর্থিক নিরাপত্তার দিকে। একটি ব্যাঙ্কিং সম্মেলনে, যেখানে উপস্থিত ছিলেন অসংখ্য ব্যাংকার ও আর্থিক প্রযুক্তি বিশেষজ্ঞ, অল্টম্যান বলেন—আজকের দিনে ব্যাংক যদি এখনও গ্রাহকের পরিচয় যাচাইয়ে কণ্ঠস্বর ব্যবহার করে, তবে সেটি "উন্মাদনা"।

তার মতে, AI এখন এমন পর্যায়ে পৌঁছেছে যেখানে কণ্ঠস্বর, সেলফি বা অন্যান্য পরিচিতি যাচাইকরণ পদ্ধতি কার্যত মূল্যহীন হয়ে পড়ছে। তিনি এটাও স্পষ্টভাবে বলেন—"আমি খুবই উদ্বিগ্ন, কারণ আমার বিশ্বাস সামনে এক ভয়াবহ প্রতারণা সংকট অপেক্ষা করছে।"

এই বক্তব্য কেবল উদ্বেগ প্রকাশ নয়, বরং এক ধরনের নৈতিক সঙ্কেতও—যেখানে প্রযুক্তি নির্মাতারা অবশেষে স্বীকার করছেন যে তাদের উদ্ভাবন বিশ্বকে এক অনিরাপদ প্রান্তে নিয়ে যাচ্ছে।

কোন কোন ব্যাংক বা আর্থিক প্রতিষ্ঠান এখনো ফোনে গ্রাহকের কণ্ঠস্বর যাচাইয়ের পদ্ধতি ব্যবহার করে, তা নিশ্চিতভাবে বলা কঠিন। তবে প্রযুক্তি ও আর্থিক খাতের বিশেষজ্ঞরা জানিয়েছেন, এই পদ্ধতির ব্যবহার পুরোপুরি অপ্রচলিত নয়; বরং অনেক ব্যাংকেই এটি পরিচয় যাচাইয়ের একটি উপায় হিসেবে বহুল ব্যবহৃত।

তবে এই পদ্ধতি সচরাচর এককভাবে ব্যবহৃত হয় না। কণ্ঠস্বর যাচাইকরণ সাধারণত একাধিক নিরাপত্তা ধাপের একটি অংশ—যার মধ্যে থাকতে পারে পাসওয়ার্ড, সিক্রেট প্রশ্ন, ফোনে পাঠানো ওটিপি, বা বায়োমেট্রিক যাচাইকরণ।

এই হাইব্রিড মডেলেই নিরাপত্তা নিশ্চিত করার চেষ্টা করা হয়, তবে সমস্যা হলো—যখন একটি দুর্বল লিঙ্ক, যেমন সহজে নকলযোগ্য কণ্ঠস্বর, সেই শৃঙ্খলের অংশ হয়, তখন গোটা কাঠামোই ঝুঁকির মুখে পড়ে।

আপনার আর্থিক প্রতিষ্ঠান কণ্ঠস্বর যাচাইকরণ (voice verification) ব্যবহার করে কিনা তা নিশ্চিত না হলে, সরাসরি গ্রাহকসেবা বিভাগে ফোন করে জানার পরামর্শ দিয়েছেন জাভেলিন সংস্থার প্রতারণা ও নিরাপত্তা বিশ্লেষক সুজান স্যান্ডো। একই সঙ্গে, আপনি চাইলে স্পষ্টভাবে জানাতে পারেন যে আপনি কণ্ঠস্বর-ভিত্তিক প্রমাণীকরণ চান না। এই পরামর্শের পেছনে একটি বৃহত্তর বার্তা আছে: ব্যবহারকারীর সচেতনতা এবং নিজস্ব ডেটা নিয়ন্ত্রণের অধিকার।

প্রযুক্তি ও আর্থিক বিশ্লেষকরা জানান, ব্যাংকসমূহ বহু দশক ধরে জালিয়াতির বিরুদ্ধে লড়াইয়ে সুদক্ষ এবং অভিজ্ঞ। স্যাম অল্টম্যান এ বিষয়ে উচ্চস্বরে হুঁশিয়ারি দিলেও, ব্যাংকিং খাত নতুন কোনো সংকেতের অপেক্ষায় ছিল না। অর্থাৎ, এআই-ভিত্তিক কণ্ঠ অনুকরণের ঝুঁকি নিয়ে তারা আগে থেকেই সচেতন ছিল এবং প্রতিরোধমূলক ব্যবস্থা গ্রহণ করে চলেছে।

বর্তমানে বিভিন্ন ব্যাংক এবং অন্যান্য শিল্পখাতের কল সেন্টারে ব্যবহৃত হচ্ছে Pindrop, GetReal ও Reality Defender-এর মতো স্টার্টআপ প্রযুক্তি, যা ফোনকলে অংশগ্রহণকারী ব্যক্তি আসল মানুষ, না কি কোনো যান্ত্রিক কণ্ঠস্বর, তা নির্ধারণে স্কোর প্রদান করে। তবু বিশেষজ্ঞ অ্যাজডার স্বীকার করেন, এআই শনাক্তকরণ প্রযুক্তিগুলো এখনো অসম্পূর্ণ এবং উন্নয়নাধীন; তবে বিশ্বাসযোগ্য প্রতিষ্ঠানগুলো এই সীমাবদ্ধতা স্বচ্ছভাবে জানিয়ে থাকে।

অ্যাজডার আশাবাদী যে, নতুন এক প্রযুক্তি প্রকল্প অডিও, ভিডিও এবং ছবিতে স্বয়ংক্রিয়ভাবে নির্ভরযোগ্য তথ্য এমবেড করার পথ তৈরি করছে—যেমন, কখন এবং কীভাবে তা নির্মিত হয়েছে, এবং সেটি একজন বাস্তব মানুষের কাছ থেকেই এসেছে কি না। এটি ডিজিটাল প্রমাণ সংগ্রহে এক নতুন দিগন্ত খুলে দিতে পারে, বিশেষত এআই জালিয়াতির যুগে।

বিশেষজ্ঞরা মনে করেন, কণ্ঠস্বর জালিয়াতি রোধে ব্যাংক, এআই সংস্থা ও নিয়ন্ত্রক সংস্থাগুলোর মধ্যে অধিকতর সমন্বয় অপরিহার্য। রিয়্যালিটি ডিফেন্ডারের সিইও বেন কোলম্যান আশাবাদ ব্যক্ত করেছেন যে, শিগগিরই যুক্তরাষ্ট্রে এ বিষয়ক একটি যথাযথ জাতীয় নীতিমালা প্রণীত হবে। তাঁর মতে, এটি “কবে হবে”—এই প্রশ্ন, “হবে কি না”—এই প্রশ্নের চেয়ে বেশি গুরুত্বপূর্ণ।

ফর্টার নামক প্রতারণা প্রতিরোধকারী সংস্থার সিইও মাইকেল রেইটব্লাট বলেন, বর্তমান এআই সংস্থাগুলো ডেটা সেন্টার, গবেষক, এবং বিপণনে বিপুল অর্থ ঢাললেও, প্রতারণা প্রতিরোধে তারা সেই মাত্রার অঙ্গীকার দেখায় না। তাঁর মতে, যদি সমান গুরুত্ব দিয়ে প্রতিরোধমূলক এআই-তেও বিনিয়োগ করা হতো, তাহলে বৃহৎ আর্থিক বিপর্যয় অনেকটা প্রতিরোধযোগ্য হতো।

এখানেই স্যাম অল্টম্যানের ব্যাংকারদের সঙ্গে আলাপ অন্যভাবে পরিচালিত হতে পারত। তিনি এআই সংস্থাগুলো কীভাবে কণ্ঠস্বর জালিয়াতির বিরুদ্ধে কার্যকর ভূমিকা রাখতে পারে, সে বিষয়ে কিছু বলেননি। (উল্লেখ্য, OpenAI এখনো তাদের এআই কণ্ঠস্বর প্রযুক্তি প্রকাশ করেনি, মূলত অপব্যবহারের আশঙ্কা থেকে।) অল্টম্যান কোনো সম্ভাব্য আইনগত কাঠামোর পক্ষে ওকালতি করেননি, যা জনগণকে অধিকতর সুরক্ষা দিতে পারত।

পরিবর্তে, অল্টম্যান দোষ চাপিয়েছেন মূলত ব্যাংকগুলোর ওপর এবং প্রস্তাব করেছেন সামাজিক স্তরে বৃহৎ রূপান্তরের। এটি অনেকটা Exxon-এর সিইও যদি বলেন, পৃথিবী তো বটে উত্তপ্ত হয়ে উঠছে—এটা কেউ না কেউ এক সময় ঠিক করবেই। এমন এক ধরনের ভঙ্গি যেখানে শক্তিশালী কর্পোরেট সংস্থার দায় এড়িয়ে দেওয়া হচ্ছে।

OpenAI এক বিবৃতিতে জানিয়েছে, কণ্ঠ অনুকরণজনিত ঝুঁকির কারণে তারা প্রযুক্তি ব্যবহারে সতর্ক থেকেছে এবং নির্দিষ্ট সুরক্ষা ব্যবস্থা নিয়েছে। তারা বলছে, ব্যাংকসহ বিভিন্ন অংশীদারের সঙ্গে তারা কাজ করছে যেন উভয় পক্ষই এআই প্রযুক্তির ক্ষমতা ও ঝুঁকি সম্পর্কে স্পষ্ট ধারণা পায় এবং সম্মিলিতভাবে কার্যকর সমাধানে পৌঁছাতে পারে।

অল্টম্যানের বক্তৃতার পরদিন হোয়াইট হাউস একটি এআই কর্মপরিকল্পনা প্রকাশ করলেও, তাতে কণ্ঠস্বর-ভিত্তিক এআই প্রতারণার ঝুঁকি উল্লেখই করা হয়নি। এর মাধ্যমে বোঝা যায়, সরকারি নীতিনির্ধারকেরা এখনো এই বিশেষ ঝুঁকিকে তাদের প্রধান অগ্রাধিকারের তালিকায় আনেননি।

সুতরাং, এখানে আলোচনার কেন্দ্রে শুধু প্রযুক্তি নয়—সিস্টেমিক আপডেট ও প্রতিরোধমূলক ব্যবস্থার জরুরি প্রয়োজনেও আছে। প্রযুক্তি যত দ্রুত অগ্রসর হচ্ছে, তার সঙ্গে তাল মেলাতে না পারলে ব্যাংক ও আর্থিক প্রতিষ্ঠানগুলো নিজেই হয়ে উঠবে প্রতারণার সহায়ক এক ভঙ্গুর পরিকাঠামো।

পড়ে থাকলে কৃতজ্ঞ—মতামত দিন, মন্দ হলে বলুন ভালো লাগেনি। এটাও তো আজকাল একটা মতামত, একশো শব্দের দ্যোতনাও আছে তাতে। লেখাটায় যদি আপনার হৃদকম্পন একটু হলেও অনুভূত হয়—হতেই পারে, তাহলে সাবস্ক্রিপশনের কায়দা আছে দু’রকম—একটা বিনা পয়সার আরেকটা টাকাওয়ালার, যেটা আপনার দয়ার দান। যেটা পারেন, সেটাই দিন, আমি তো এদিকে কিবোর্ড ঠুকে মরেই যাচ্ছি।